Entra en vigor en la UE la primera Ley de Inteligencia Artificial del mundo: claves y objetivos

Desde hoy, está en vigor en la Unión Europea la Ley de Inteligencia Artificial (IA), la primera del mundo para regular unos sistemas que permiten actuar de manera más precisa y eficiente que los humanos en muchos ámbitos e impulsar la innovación, pero que a la vez plantean importantes riesgos que el nuevo marco común trata de evitar. La norma busca impulsar la excelencia y la innovación tecnológica asegurando la protección de los derechos humanos.

Estas son las cinco claves principales de la nueva norma:

Objetivos

Los principales objetivos son establecer un marco jurídico armonizado en la Unión Europea para el desarrollo, la comercialización, la puesta en marcha y el uso de los sistemas de Inteligencia Artificial (IA), un área que puede generar muchos beneficios pero que conlleva riesgos. Asimismo, se pretende impulsar la innovación y erigir a Europa en líder del sector.

A quién se aplica

Las normas se aplican a los proveedores de sistemas de IA que se pongan en servicio o comercialicen dentro de la UE o cuya salida se utilice en la UE, con independencia de su origen. También a usuarios de los mismos, considerando usuarios a quienes explotan esos sistemas.

No se aplica a las autoridades públicas de terceros países ni a organizaciones internacionales cuando utilicen sistemas IA en el ámbito de la cooperación policial o judicial con la UE, y tampoco a los sistemas de uso militar o utilizados en el contexto de la seguridad nacional, ni a los usados con el solo propósito de la investigación y el desarrollo científico.

La nueva ley pone un énfasis significativo en la transparencia. Las empresas deben informar a los usuarios cuando estén interactuando con un sistema de IA, ya sea en llamadas telefónicas o en chats donde interfieran chatbots.

Tipos de sistemas de IA

La ley establece cuatro tipo de sistemas de IA: prohibidos, de alto riesgo, con requisitos de transparencia y de propósito general.

En el bloque de los prohibidos se incluyen los que desplieguen técnicas subliminales para distorsionar el comportamiento de una persona de manera que pueda causarle daños físicos o psicológicos a él o a otros, los sistemas de categorización biométrica, la captura indiscriminada de imágenes faciales de internet, el reconocimiento de emociones en el lugar de trabajo y en las escuelas, los sistemas de "puntuación" de las personas en función de su comportamiento o características, la actuación policial predictiva y la IA que manipule el comportamiento humano o explote las vulnerabilidades de las personas.

No obstante, la normativa permite excepciones. Los sistemas de identificación biométrica "en tiempo real" solo se podrán emplear si se cumplen una serie de salvaguardias. Entre estos casos pueden figurar la búsqueda selectiva de una persona desaparecida o la prevención de un atentado terrorista.

Multas

Las multas se modularán según las circunstancias y valorarán el tamaño del proveedor. Para quienes incumplan la normativa se prevén multas con un rango que va desde los 35 millones de euros o el 7% del volumen global de negocio de las empresas hasta los 7,5 millones de euros o el 1,5% del volumen global de negocio.

Fases en la aplicación de la nueva ley

Tras su entrada en vigor este 1 de agosto, será de plena aplicación veinticuatro meses después, con excepción de las prohibiciones de prácticas, que se aplicarán seis meses después de la fecha de entrada en vigor, es decir, en febrero de 2025.

En agosto de 2025 empezarán a aplicarse las normas para los modelos de uso generalista, como ChatGPT, y un año después, en agosto de 2026, se aplicará la ley de manera general, salvo algunas disposiciones.

Las obligaciones para los sistemas de alto riesgo comenzarán a aplicarse 36 meses después, en agosto de 2027.

Te puede interesar

La función erótica de ChatGPT queda en pausa mientras OpenAI mejora el asistente

La compañía tecnológica ha decidido posponer sin nueva fecha esta función, que permitiría a usuarios adultos verificados acceder a contenido erótico, para priorizar mejoras en la inteligencia del sistema y en su capacidad de personalización.

La IA puede ser "letal" en personas vulnerables mentalmente, advierte un psiquiatra

La Inteligencia Artificial "no tiene conciencia, no tiene compasión y no quiere" a su usuario, por lo que se trata de una herramienta a la que "le da igual lo que te pase". Además, generalmente es "complaciente" y dice a las personas "lo que quieren escuchar".

El Gobierno español pedirá a la Fiscalía que investigue posibles delitos de X, Meta y TikTok

"Estas plataformas están atentando contra la salud mental, la dignidad y los derechos de nuestros hijos e hijas. El Estado no lo puede permitir", ha subrayado Pedro Sánchez en X.

A más uso de las redes sociales mayor aislamiento en jóvenes, según un estudio

El análisis de los resultados indica que a más uso de las redes, más solos confesaban sentirse los jóvenes. Así, quienes usan las redes al menos 30 horas a la semana, son un 38 % más propensos a declarar soledad frente a quienes las utilizan menos de 16 horas semanales.

El Gobierno checo, también a favor de prohibir las redes sociales a menores de 15 años

En un vídeo colgado hoy en X, el jefe de Gobierno checo formado por populistas, derechistas y eurocríticos, en el poder desde finales del año pasado, ha asegurado que apoya una prohibición como la impulsada por Francia, donde las redes sociales serán vetadas para los jóvenes menores de 15 años.

Bruselas concluye que el diseño "adictivo" de TikTok vulnera la ley comunitaria

La Comisión Europea ha puntualizado que, al "recompensar" constantemente a los usuarios con nuevos contenidos, ciertas características de diseño de TikTok alimentan la necesidad de seguir desplazándose por la pantalla y haciendo que el cerebro de los usuarios entre "modo piloto automático", lo que puede conducir a un comportamiento compulsivo y reducir el autocontrol de los usuarios. TikTok dice que es "categóricamente falso" que tenga un diseño adictivo.

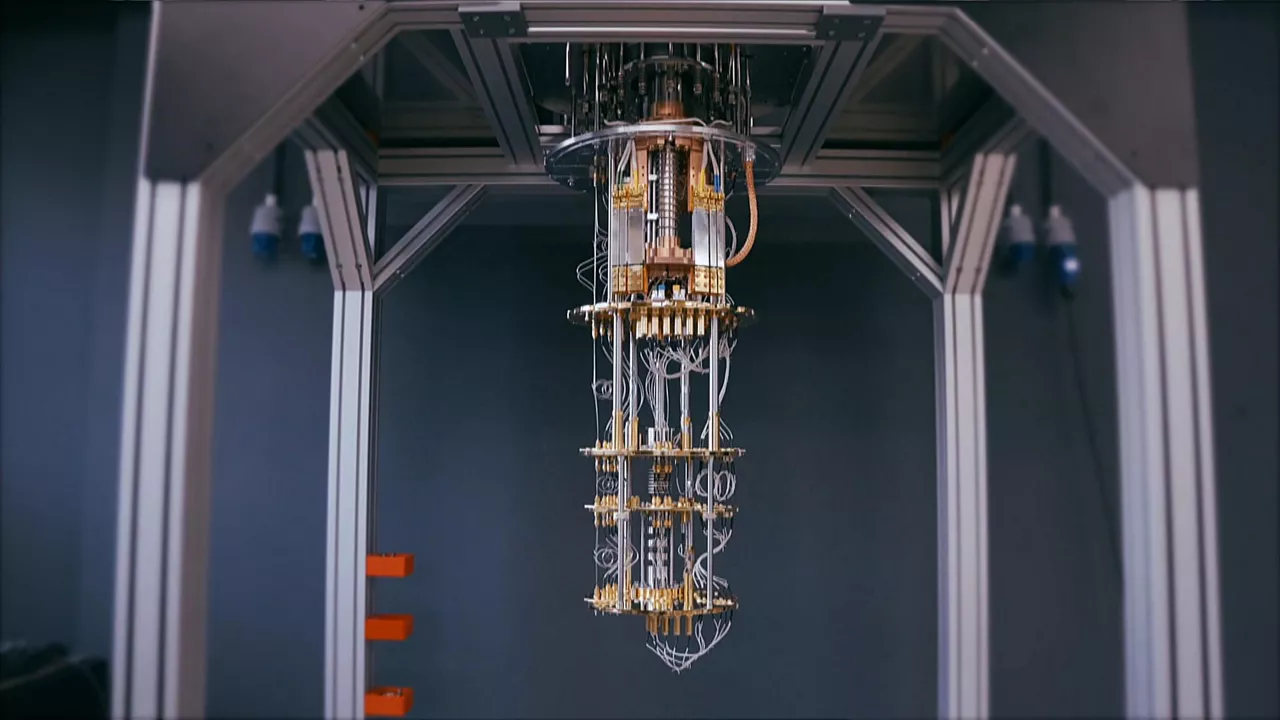

Visita a la torre cuántica, el lugar donde crearán los chips para el desarrollo de la computadora cuántica

La torre cuántica se ha construido adosada al CIC Nanogune de Donostia-San Sebastián. Allí, entre otras cosas, se ha instalado un refrigerador de dilución y será el lugar donde elaborarán los chips que el ordenador cuántico necesita.

Australia y Francia marcan el camino para la regulación de redes sociales a menores

Australia y Francia se convirtieron en los primeros países del mundo en limitar el acceso de adolescentes a las redes sociales, estableciendo precedentes que podrían inspirar al Gobierno español a adoptar una medida similar.

La Comisión Europea abre expediente sancionador a X por las imágenes sexualizadas de Grok

Bruselas evaluará si X ha examinado y mitigado los riesgos asociados con la puesta en marcha de las funciones de su inteligencia artificial, Grok, en la Unión Europea.

Investigan nuevas filtraciones de datos de Pradales, Chivite y otros presidentes autonómicos

El 'hacker' de sobrenombre Eurogosth ha difundido el DNI, direcciones o teléfonos de responsables autonómicos, mientras que el 'hacker' con el alias Vindex, ha difundido en dos fases información de carácter personal del ministro Puente y otros altos cargos de Transportes.