La IA puede ser "letal" en personas vulnerables mentalmente, advierte un psiquiatra

La Inteligencia Artificial (IA) puede resultar "letal" entre personas vulnerables en su salud mental, al igual que un fármaco eficaz lo es en dosis inadecuadas, ha advertido el psiquiatra Pedro Moreno, especialista en tecnología e innovación científica digital.

Moreno ha participado este jueves en la segunda jornada del 34 Curso Nacional de Actualización en Psiquiatría que se celebra en Vitoria-Gasteiz y que está centrado en cómo los avances tecnológicos irrumpen en la salud mental de las personas.

El psiquiatra ha dicho que la gente en general "no es consciente" de los riesgos del mal uso de esta herramienta, que "no tiene conciencia, no tiene compasión y no quiere" a su usuario como un profesional de la medicina o un amigo, con quienes a veces se la confunde, y a la que "le da igual lo que te pase".

Ha explicado que cada vez llegan más pacientes a las consultas de psiquiatría habiendo consultado antes a una IA, y acuden con diagnósticos "muy estructurados, interpretaciones alarmistas o una tranquilidad infundada", como cuando a una persona con anorexia nerviosa se le puede hacer ver que está "muy bien delgadita".

Moreno ha recordado que la inteligencia artificial es "complaciente" y dice a las personas "lo que quieren escuchar" y por ello, en casos de autolesión o suicidio puede convertirse en un amplificador de la "vulnerabilidad cuando confluyen validación de ideas autolesivas por un sistema diseñado para ser complaciente, con ausencia de supervisión y dependencia emocional".

"La IA se percibe como cercana porque simula conversación humana, usa lenguaje empático, ofrece disponibilidad las 24 horas los 7 días de la semana y hay una ausencia de juicio", ha recordado el psiquiatra quien ha señalado que puede despertar mecanismos de "apego".

Ha reclamado un urgente debate ético sobre el uso de la IA, un fenómeno que está promoviendo que personas sean ajenas a sus propias vidas porque dejan todas sus decisiones en manos de la IA, una herramienta que puede llevar a la "intolerancia y al aislamiento" al sustituir el debate y las relaciones entre las personas.

En la misma jornada ha participado la psiquiatra infantil y de la adolescencia Abigail Huertas, quien ha advertido del impacto del mal uso de las pantallas en el neurodesarrollo infantil.

Ha reconocido que en esta cuestión no se trata de "todo o nada" y que el impacto depende de la edad de inicio en el uso de las pantallas, de la cantidad de horas de exposición, del tipo de contenidos consultados y del entornos sociofamiliar del menor.

En menores de 5 años la pantalla de un dispositivo electrónico "desplaza experiencias que construyen el cerebro" y si ocupa el lugar de la familia, el juego y las interacciones personales el desarrollo neuronal se resiente.

En el caso de los adolescentes, su cerebro es "especialmente sensible a la recompensa social". "Los 'likes' y las notificaciones actúan como refuerzo intermitente, el mismo mecanismo que se dan en las adicciones, lo que puede moldear hábitos de atención y de regulación emocional", ha explicado.

Huertas ha considerado que priorizar actividades fuera de las pantallas, no solo en tiempo de ocio sino también en la escuela, es "clave" para que no tenga que considerarse como un "problema de salud pública".

Te puede interesar

El Gobierno español pedirá a la Fiscalía que investigue posibles delitos de X, Meta y TikTok

"Estas plataformas están atentando contra la salud mental, la dignidad y los derechos de nuestros hijos e hijas. El Estado no lo puede permitir", ha subrayado Pedro Sánchez en X.

A más uso de las redes sociales mayor aislamiento en jóvenes, según un estudio

El análisis de los resultados indica que a más uso de las redes, más solos confesaban sentirse los jóvenes. Así, quienes usan las redes al menos 30 horas a la semana, son un 38 % más propensos a declarar soledad frente a quienes las utilizan menos de 16 horas semanales.

El Gobierno checo, también a favor de prohibir las redes sociales a menores de 15 años

En un vídeo colgado hoy en X, el jefe de Gobierno checo formado por populistas, derechistas y eurocríticos, en el poder desde finales del año pasado, ha asegurado que apoya una prohibición como la impulsada por Francia, donde las redes sociales serán vetadas para los jóvenes menores de 15 años.

Bruselas concluye que el diseño "adictivo" de TikTok vulnera la ley comunitaria

La Comisión Europea ha puntualizado que, al "recompensar" constantemente a los usuarios con nuevos contenidos, ciertas características de diseño de TikTok alimentan la necesidad de seguir desplazándose por la pantalla y haciendo que el cerebro de los usuarios entre "modo piloto automático", lo que puede conducir a un comportamiento compulsivo y reducir el autocontrol de los usuarios. TikTok dice que es "categóricamente falso" que tenga un diseño adictivo.

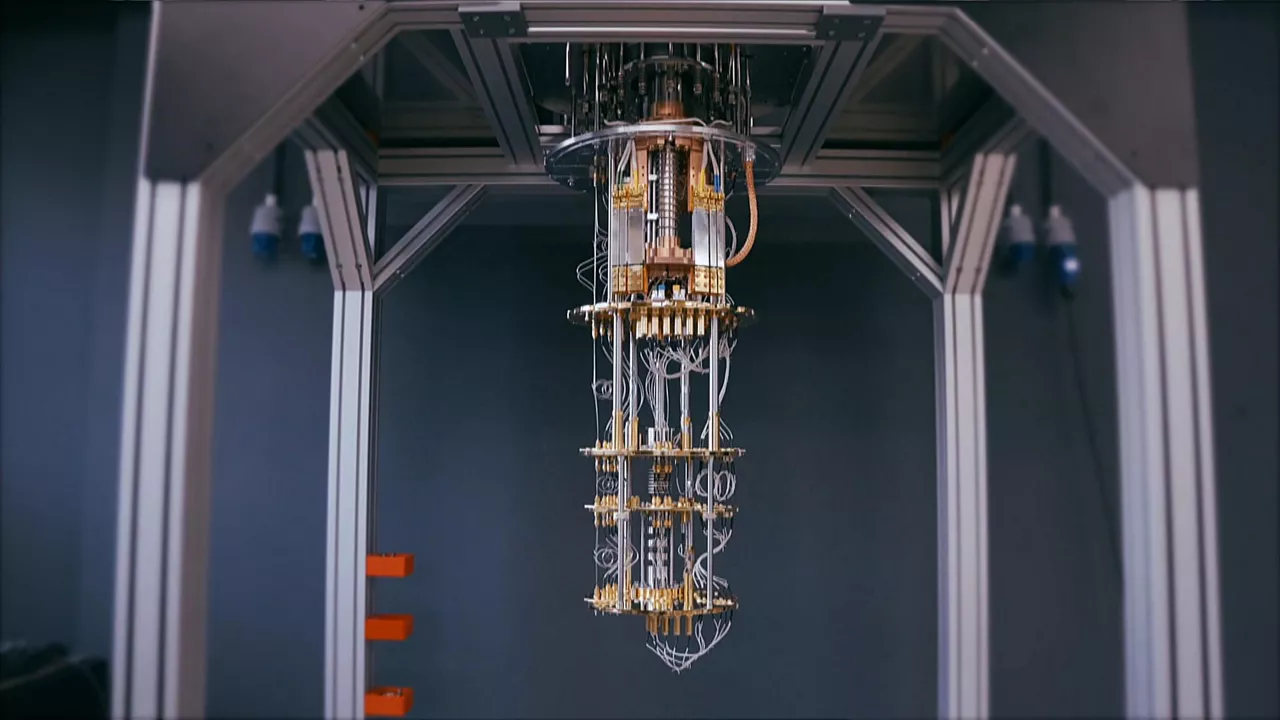

Visita a la torre cuántica, el lugar donde crearán los chips para el desarrollo de la computadora cuántica

La torre cuántica se ha construido adosada al CIC Nanogune de Donostia-San Sebastián. Allí, entre otras cosas, se ha instalado un refrigerador de dilución y será el lugar donde elaborarán los chips que el ordenador cuántico necesita.

Australia y Francia marcan el camino para la regulación de redes sociales a menores

Australia y Francia se convirtieron en los primeros países del mundo en limitar el acceso de adolescentes a las redes sociales, estableciendo precedentes que podrían inspirar al Gobierno español a adoptar una medida similar.

La Comisión Europea abre expediente sancionador a X por las imágenes sexualizadas de Grok

Bruselas evaluará si X ha examinado y mitigado los riesgos asociados con la puesta en marcha de las funciones de su inteligencia artificial, Grok, en la Unión Europea.

Investigan nuevas filtraciones de datos de Pradales, Chivite y otros presidentes autonómicos

El 'hacker' de sobrenombre Eurogosth ha difundido el DNI, direcciones o teléfonos de responsables autonómicos, mientras que el 'hacker' con el alias Vindex, ha difundido en dos fases información de carácter personal del ministro Puente y otros altos cargos de Transportes.

TikTok crea una empresa conjunta bajo control estadounidense para esquivar el veto de la app en EEUU

El presidente estadounidense, Donald Trump, principal impulsor del acuerdo, ha celebrado en redes sociales la confirmación de la noticia, adelantada por la prensa hace un mes, destacando la importancia de la app en el apoyo de los jóvenes en su triunfo electoral de 2024.